Как мы избегаем «галлюцинаций» ИИ: гибридный подход к анализу данных в SL Soft

Разбираем, почему LLM нельзя использовать как единственный инструмент обработки данных. Объясняем трёхслойную архитектуру: алгоритмическая обработка, ML-классификация и контекстный анализ для точности результата.

Материал актуален для сервиса по НСИ. В других решениях SL Soft применяются свои методики, и механизм работы может отличаться.

В чем проблема больших языковых моделей

Большие языковые модели (LLM) открыли бизнесу доступ к новым возможностям: генерация текстов, интеллектуальный поиск, быстрый анализ документов. Но у этой технологии есть ограничение — так называемые «галлюцинации». Модель может сгенерировать убедительный, но неточный результат. Для развлечений это простительно, а вот в корпоративной аналитике цена ошибки слишком высока.

Поэтому в SL Soft мы используем LLM не как самостоятельный инструмент, а как часть гибридного подхода.

Алгоритмы + ML + LLM

Наши решения строятся в несколько слоев:

- Алгоритмические методы выполняют первичный разбор: выделяют коды, параметры, структуру записи. Они гарантируют, что данные трактуются формально и без «фантазии».

- Модели машинного обучения классифицируют объекты и «узнают» их даже при вариациях в написании (например, «пруток» и «пруточек»).

- LLM помогают анализировать контекст и формировать нормализованную запись.

Почему это работает

Такой подход снимает главный риск: мы не полагаемся на LLM при критических этапах обработки информации. Ошибки OCR, расхождения в одну букву или несогласованность справочников решаются проверенными методами. LLM используется как «экспрессивный слой», а не как единственный источник истины.

На практике это позволяет автоматически нормализовать десятки и сотни тысяч записей, сохраняя высокую точность и снижая вовлеченность экспертов до минимума.

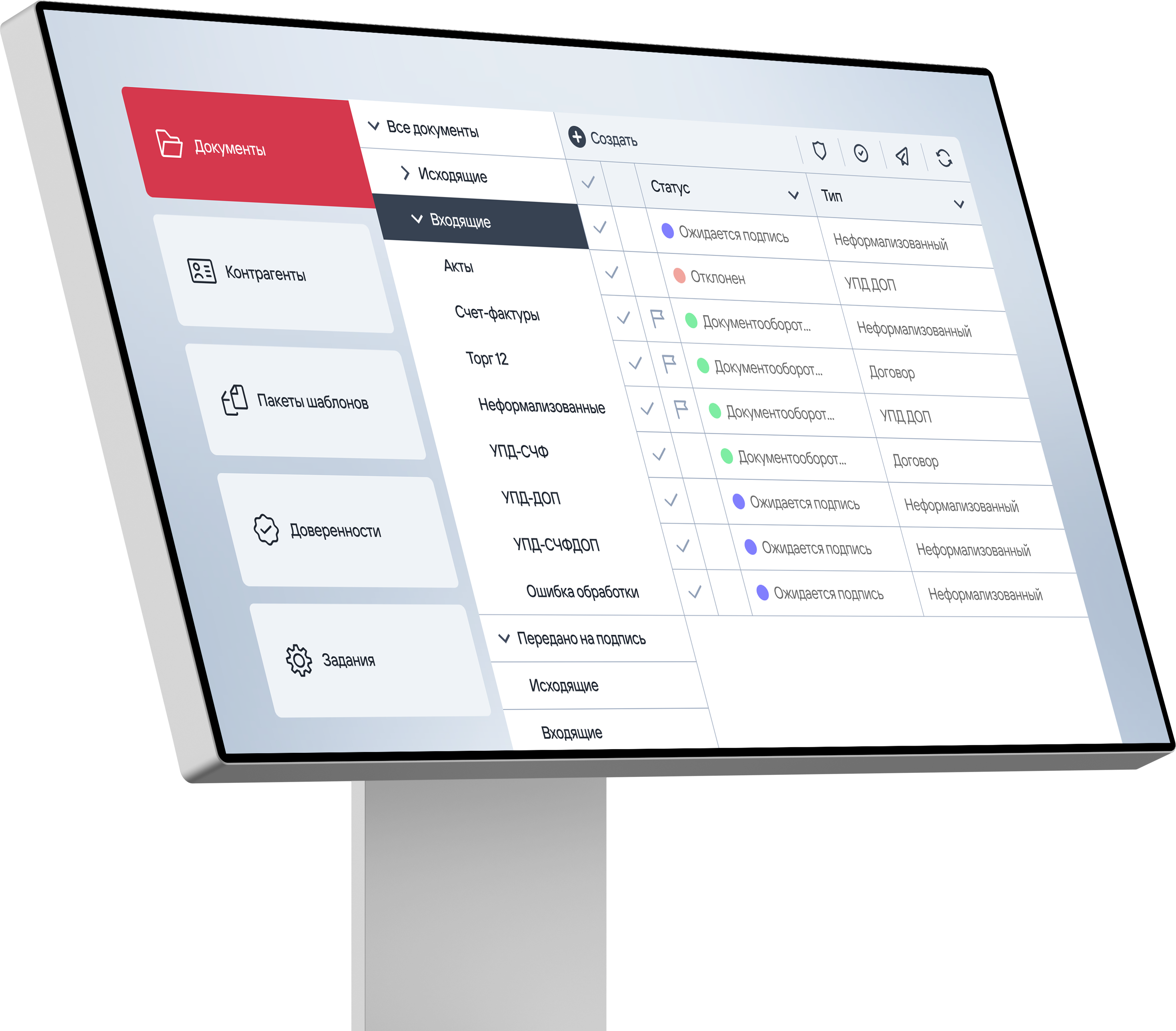

С продуктами SL Soft клиенты получают точные данные без риска галлюцинаций ИИ — и могут полагаться на систему при управлении закупками, аналитикой или документооборотом.

по любому вопросу